هر محصولی جنبههای خوب و بد دارد و هوش مصنوعی هم از این قائده مستثنی نیست. چهرههای برجسته زیادی مثل استیون هاوکینگ درباره خطرات احتمالی هوش مصنوعی هشدار داده اند.

در ادامه مطلب به شش مورد از نمونههای عبور هوش مصنوعی از خط قرمزها میپردازیم.

۱. استفاده از هوش مصنوعی برای پیش بینی جرم

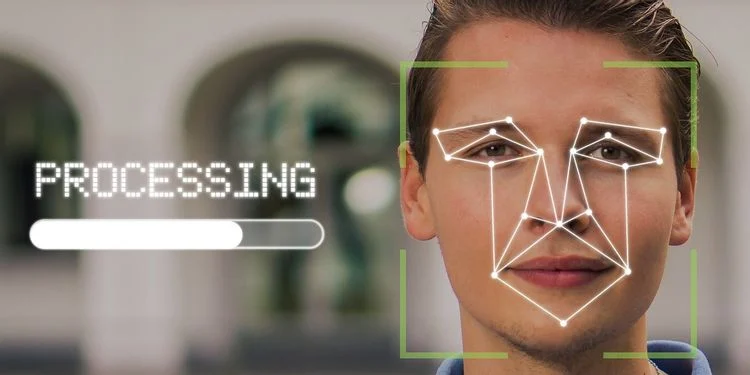

تحقیقات آکادمیک ستون اصلی پیشرفتهای علمی هستند اما گاهی اوقات در این تحقیقات هم افراط میشود مثل تحقیقی که در آن از هوش مصنوعی برای تشخیص مجرم بودن شخص از روی چهره او استفاده میکرد.

در سال ۲۰۲۰ محققان دانشگاه هریسبورگ اعلام کردند که نرمافزار تشخیص چهره ای طراحی کرده اند که میتواند از روی یک عکس چهره، با دقت ۸۰ درصد و بدون تعصب نژادی مجرم بودن فرد را پیش بینی کند.

در واکنش به این اعلامیه ۲۴۲۵ کارشناس نامه ای امضا کرده و از مجله مورد نظر خواستند از انتشار این تحقیق و تحقیقات مشابه در آینده خودداری کند چون چنین فناوریهایی میتواند باعث ایجاد ناعدالتی شده و آسیب جدی به جامعه وارد کنند.

۲. لباس زیر هوشمند Skiin

طراحان این لباس ادعا میکردند که این محصول میتواند با ضبط اطلاعات بدن مثل ضربان قلب، موقعیت بدنی، دمای بدن، موقعیت و تعداد گامها، کاری کند که حس کنید لباس زیر دلخواهتان را پوشیده اید.

حسگرهای این لباس زیر دائماً چنین اطلاعاتی را جمع آوری کرده و به همراه اطلاعات به دست آمده از اپلیکیشن مخصوص گوشی Skiin، تحلیل میکنند.

به غیر از اینکه کاربر باید فراموش نکند که هر شب لباس زیرش را شارژ کند، چنین طراحی این سوال را در ذهن ایجاد میکند که آیا امکان نصب این حسگرها در نقاط دیگری از بدن وجود نداشته؟!

۳. جعل عمیق و DeepNude

DeepNude اپلیکیشن هوش مصنوعی بود که با یک کلیک تصاویری بسیار نزدیک به واقعیت از زنان به صورت برهنه ایجاد میکرد. کافی بود کاربران عکس شخص مورد نظر را به این اپلیکیشن بارگذاری کنند تا یک تصویر برهنه جعلی از او ساخته شود.

انتقادات وارد شده به این اپلیکیشن باعث حذف سریع آن از اینترنت شد. اما متأسفانه اپلیکیشنهای مشابه در اینترنت فراوان هستند. مثلاً طبق گزارش Sensity، در تلگرام از رباتهای دیپ فیک برای ایجاد تصویر برهنه جعلی از زنان استفاده میشود.

۴. چت بات نازی مایکروسافت، Tay

مایکروسافت در سال ۲۰۱۶ یک چت بات هوش مصنوعی به اسم Tay را در توئیتر منتشر کرد که برای یادگیری به روش تعامل با کاربران از طریق توئیتها و تصاویر آنها طراحی شده بود.

ظرف کمتر از ۲۴ ساعت شخصیت Tay از یک دختر نسل هزاره کنجاو تبدیل به یک هیولای فتنه انگیز نژادپرست شد!

این چت بات در اصل طوری طراحی شده بود تا شخصیت یک دختر آمریکایی نوجوان را شبیه سازی کند اما با اقدامات و توئیتهای تحریک آمیز بعضی کاربران تبدیل به شخصیتی کاملاً متفاوت شد. در نهایت مایکروسافت حساب کاربری Tay را با اعلام اینکه این چت بات تحت یک حمله سازماندهی شده قرار گرفته، تعلیق کرد.

۵. من انسانها را نابود خواهم کرد!

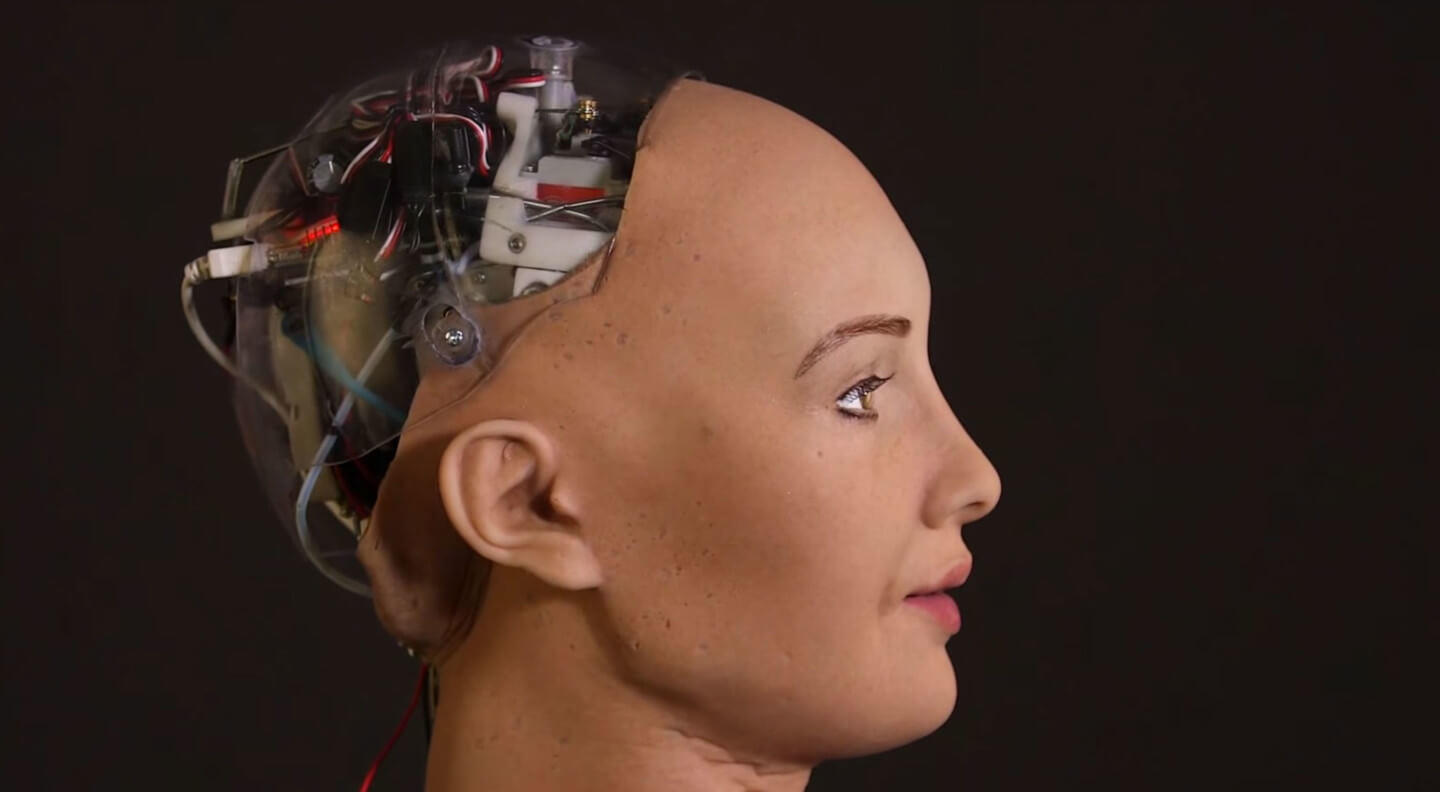

شرکت Hanson Robotics در مارس ۲۰۱۶ پس از مدتها تجربه در این حوزه، رباتی به اسم سوفیا را معرفی کرد.

سوفیا با الگوریتمهای یادگیری ماشینی آموزش داده شده بود تا مهارتهای گفتگو را یاد بگیرد و در چند مصاحبه تلویزیونی شرکت کرد.

در اولین مصاحبه عمومی در اتاقی که پر از کارشناسان فناوری بود، David Hanson مدیرعامل این شرکت از سوفیا پرسید که آیا خواستار نابودی انسانها است؟ و او پاسخ داده “اکی، من انسانها را نابود میکنم” و با این پاسخ همه حاضران در اتاق را شوکه کرد.

۶. seebotschat

تیم سازنده اکانت توئیچ seebotschat ایده جالبی داشت به این صورت که دو دستگاه هوشمند گوگل را کنار هم بگذاریم تا با هم گفتگو کنند و نتیجه را به صورت آنلاین منتشر کنیم.

این اکانت ۶۰ هزار فالور داشت و میلیونها نفر به صورت زنده این مصاحبه را دنبال میکردند. نتیجه این شد که این دو هوش مصنوعی از بحث درباره مسائل معمولی به بررسی سوالات وجودی عمیق مثل معنای زندگی رسیدند. بعد از آن بحث این دو ربات داغ تر شد و همدیگر را به ربات بودن متهم کردند، سپس شروع به گفتگو درباره عشق کردند و بعد دوباره جدال آنها شروع شد.

این اتفاق باعث شد عده ای به این فکر کنند که وقتی دو دستیار هوشمند رباتی به سرعت با هم درگیر شده و مشکل پیدا میکنند، آیا میتوان امیدی به گفتمان آینده بین انسان و رباتها داشت؟